라마2 뛰어 넘은 LLM 등장, 데이터브릭스 ‘DBRX’ 출시

현존 최고 성능 오픈소스 LLM… 비용 절감 이점

데이터 관리 및 AI 솔루션 기업 데이터브릭스가 현존 최고 성능을 갖춘 오픈소스 대형언어모델(LLM) ‘DBRX’를 출시했다고 27일(현지시각) 밝혔다. DBRX는 표준 벤치마크에서 메타의 라마2(Llama2)를 비롯한 모든 오픈소스 범용 LLM의 점수를 능가했다.

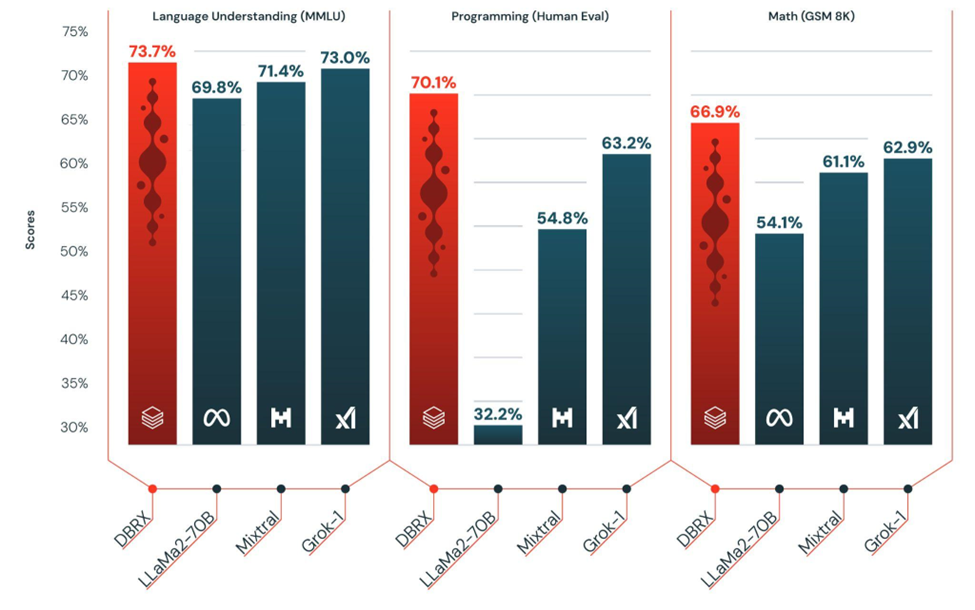

DBRX가 두각을 보이는 부분은 언어 이해, 프로그래밍, 수학 및 논리 분야로, 해당 영역에서 라마 2-70B, 믹스트랄-8x7B, 그록-1 등 주요 개방형 모델의 성능을 능가했다. 또 대부분의 벤치마크에서 오픈AI의 폐쇄형 모델 GPT-3.5를 앞질렀다. 다만 폐쇄형 모델 중 최고 성능을 발휘하는 GPT-4나 클로드3 오푸스에는 미치지 못했다.

DBRX는 다른 주요 LLM 대비 최대 2배 높은 컴퓨팅 효율을 갖췄다. 비결은 매개변수 효율화로, 회사에 따르면 DBRX는 1320억개 파라미터를 갖췄지만 답변 시 360억개 매개변수만 사용하는 방식으로 작동해 추론 속도를 높였다.

DBRX는 현재 무료로 이용할 수 있다. 업계에서는 이번 출시를 통해 비용을 절약하기 위해 오픈소스 LLM을 도입하려는 기업의 움직임이 더욱 확대될 것으로 전망했다.

알리 고드시 데이터브릭스 CEO는 “전문가 혼합 아키텍처를 사용하는 DBRX는 초당 토큰 전송 속도가 빨라 비용 효율적”이라며 “기업은 자체 데이터를 기반으로 맞춤형 플랫폼을 구축할 수 있을 것”이라고 설명했다.

뉴스콘텐츠는 저작권법 제7조 규정된 단서조항을 제외한 저작물로서 저작권법의 보호대상입니다. 본 기사를 개인블로그 및 홈페이지, 카페 등에 게재(링크)를 원하시는 분은 반드시 기사의 출처(로고)를 붙여주시기 바랍니다. 영리를 목적으로 하지 않더라도 출처 없이 본 기사를 재편집해 올린 해당 미디어에 대해서는 합법적인 절차(지적재산권법)에 따라 그 책임을 묻게 되며, 이에 따른 불이익은 책임지지 않습니다.

- 에디터장준영 (zzangit@ditoday.com)