그동안 AI가 내 CT 사진 마음대로 썼다?… 개인정보 가명처리 새기준 나왔다

생성형 AI 개인정보 가이드라인도 올해 중에 순차 발표 예정

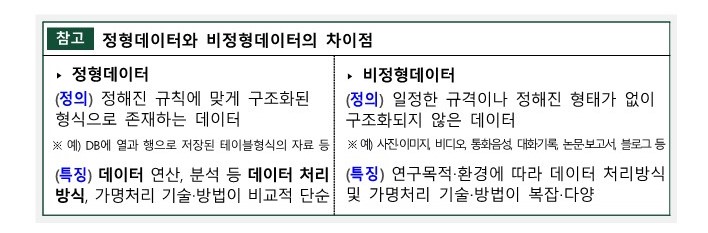

개인정보보호위원회가 인공지능(AI) 시대 기술개발의 핵심 자료인 비정형데이터에 대한 가명처리 기준 가이드라인을 새롭게 개정했다고 4일 밝혔다.

이번 가이드라인 개정은 최근 AI 기술의 발달로 이목구비를 알아보기 힘든 CCTV 영상, 흉부 컴퓨터단층촬영(CT) 촬영 사진 등 비정형 데이터 활용수요가 폭발적으로 증가했지만, 기존 가이드라인은 적합한 구분 기준이나 가명처리 방법·수준이 없어 불확실성이 크다는 지적에 따라 진행됐다.

개정된 가이드라인은 의료‧교통‧챗봇 등 주요 7개 분야에 맞게 각 분야 사례 및 시나리오를 제공함으로써 현장에서 손쉽게 활용할 수 있도록 한 것이 특징이다.

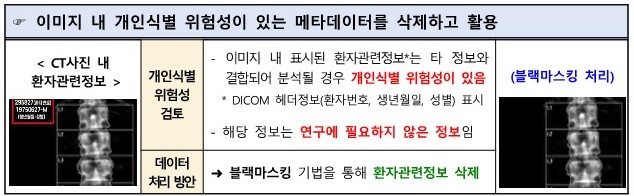

예를 들어, 유방암·골밀도 감소 여부를 진단하는 AI를 개발하는 과정에서 병원에서 환자의 CT 데이터를 사용할 때 ‘블랙마스킹’ 기법으로 가명 처리해 CT 사진 내 환자 번호나 생년월일, 성별 등을 지우도록 권고했다.

CCTV와 같은 교통정보 등에 비정형데이터를 활용할 경우 행인이나 차량 탑승자의 얼굴과 차량 번호판을 컴퓨터가 식별할 수 없는 수준으로 가려야 한다고 했다. AI 챗봇의 경우, 언어 학습에 활용된 가명 정보가 그대로 답변으로 나오지 않도록 ‘학습 데이터베이스’와 ‘답변 데이터베이스’를 분리해 처리할 것을 명시했다. 또 이메일 주소와 ID 등 개인이 식별될 수 있는 항목들을 가명 처리해야 한다.

또한 개인정보위는 데이터 위험성을 미리 스스로 진단할 수 있도록 ‘개인식별 위험성 검토 체크리스트’도 마련했다. 추가로 새로운 기술이나 서비스를 개발하는 과정에서 개인정보 보호법을 준수하고 있는지 사전적정성 검토를 신청할 수도 있다.

앞으로 개인정보위는 신청받은 사례를 전문가들과 함께 신속히 검토하여 회신하는 한편, 관련 사례를 가이드라인에 지속 추가하여 모범사례를 확산시켜 나가겠다는 것이 위원회의 계획이다.

고학수 개인정보위 위원장은 “인공지능 등 많은 신기술 영역은 현장의 불확실성을 해소할 수 있는 세밀한 데이터 처리정책이 중요하다”면서, “금번 가이드라인을 시작으로 대규모 언어모형 등 생성형 AI와 관련한 공개된 개인정보 처리 가이드라인등 현장의 어려움을 해소할 수 있는 기준을 올해 중에 순차적으로 발표하겠다”고 밝혔다.

뉴스콘텐츠는 저작권법 제7조 규정된 단서조항을 제외한 저작물로서 저작권법의 보호대상입니다. 본 기사를 개인블로그 및 홈페이지, 카페 등에 게재(링크)를 원하시는 분은 반드시 기사의 출처(로고)를 붙여주시기 바랍니다. 영리를 목적으로 하지 않더라도 출처 없이 본 기사를 재편집해 올린 해당 미디어에 대해서는 합법적인 절차(지적재산권법)에 따라 그 책임을 묻게 되며, 이에 따른 불이익은 책임지지 않습니다.

- 에디터김동욱 (jkkims@ditoday.com)