“4,000개 언어 알아듣는다”… 메타, 음성 인식 AI 공개

세계 1,100개 언어 ‘음성↔텍스트’ 변환

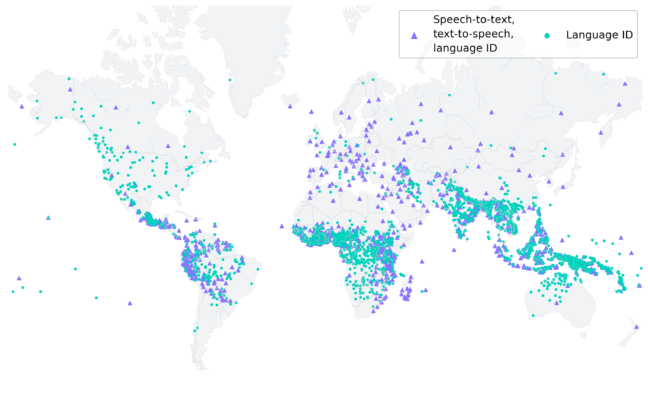

4,000개 이상의 음성 언어를 식별하고, 약 1,100개의 언어를 ‘음성↔텍스트’로 변환하는 인공지능(AI) 모델이 나왔다.

메타는 24일 이 같은 성능의 ‘대규모 다국어 음성 인식(Massively Multilingual Speech, 이하 MMS)’ AI 모델을 오픈소스로 공개했다고 밝혔다. 메타의 MMS 프로젝트는 많은 사람이 더 쉽게 정보에 접근하고 자신이 원하는 언어로 각종 기기를 사용할 수 있도록 돕는 것을 목표로 한다.

현존하는 언어는 7,000개 이상이다. 기존 메타 음성 인식 AI 모델은 100여 개의 언어에 대해서만 음성-텍스트 변환을 지원했는데, 이번 모델은 10배 이상 확대된 1,107개 언어를 지원한다. 음성으로 단순 식별만 할 수 있는 언어는 약 4,000개로 기존보다 40배가량 늘었다.

성능도 발전했다. 메타의 분석 결과, 음성 변환 언어 수를 늘렸을 때 문자 오류율은 단 0.4% 증가했다. 또 경쟁사인 오픈AI의 음성인식 모델 ‘위스퍼(Whisper)’와 유사 비교를 수행한 결과, MMS 데이터로 교육된 모델은 단어 오류율을 절반으로 줄이면서도 11배 더 많은 언어를 처리할 수 있는 것으로 나타났다.

메타는 이번 MMS 모델 및 코드를 오픈소스로 공개한다. 언어 다양성 보존에 기여하고, AI 생태계 전반의 발전과 책임 있는 개발을 지원하기 위함이다.

메타 관계자는 “향후 수천 개 언어를 지원하는 단일 음성 모델 구축을 위해 적용 언어 범위를 늘리고, 기존 음성 기술로는 다루기 어려운 방언 처리 문제 해결을 위해 노력할 계획”이라며, “발전된 음성 인식 기술은 VR 및 AR 기술 영역이나 메시지 서비스에 적용돼 혁신을 주도할 수 있다”고 설명했다.

한편, AI는 메타의 다양한 제품과 서비스의 기반이자 메타버스를 향한 중장기적 비전 실현의 근간이 되는 핵심 기술이다. AI 인프라스트럭처 구축과 AI 모델 고도화, 디지털 마케팅 경험 개선 등 3가지 분야에 집중하여 AI에 대한 연구와 투자를 지속해오고 있다.

뉴스콘텐츠는 저작권법 제7조 규정된 단서조항을 제외한 저작물로서 저작권법의 보호대상입니다. 본 기사를 개인블로그 및 홈페이지, 카페 등에 게재(링크)를 원하시는 분은 반드시 기사의 출처(로고)를 붙여주시기 바랍니다. 영리를 목적으로 하지 않더라도 출처 없이 본 기사를 재편집해 올린 해당 미디어에 대해서는 합법적인 절차(지적재산권법)에 따라 그 책임을 묻게 되며, 이에 따른 불이익은 책임지지 않습니다.

- 에디터장준영 (zzangit@ditoday.com)