챗GPT-딥페이크 기술 악용한 피싱 범죄 피해 속출

딥페이크 기술로 날로 수법 견고… 의심날 땐 고향과 출신학교 등 물어봐야

챗GPT, 바드 등 이용자의 특정 요구에 따라 결과를 능동적으로 생성해 내는 인공지능 기술인 생성형 AI가 세계적으로 휘몰아치면서 이 기술을 악용한 피싱 범죄가 발생해 주의가 당부된다. 문제는 전문가도 이러한 최신 수법의 피싱 사례를 사전에 감지하고 대응하기가 쉽지 않아 자칫 피해 사례가 눈덩이처럼 커질 수도 있다는 점이다.

국정원은 최근 AI를 비롯한 최신 IT 기술을 활용한 국제 범죄가 날로 진화하고, 세계 각국에서 관련 범죄가 빗발침에 따라 이에 대응할 수 있는 최신 수법과 사례를 알렸다.

챗GPT로 시나리오 개발… 웹사이트와 앱으로 정보 편취

국정원은 특히, 챗GPT를 악용한 피싱 가능성과 정교한 딥페이크 기술 사기에 주목했다. 챗GPT는 훈련된 자연언어처리 모델인 대화형 AI 서비스다. 교육시장부터 기업 홍보 마케팅 및 미디어 콘텐츠 등 산업 전반에 새로운 워크플로우를 제시할 정도로 빠르게 일상에 스며들고 있다.

피싱 범죄는 이 틈을 놓치지 않았다. 국정원은 피싱 범죄자들이 AI 기술로 사기 시나리오를 개발, 피싱 메시지 작성에 악용하는 것은 물론 가짜 챗GPT 웹사이트와 앱을 개발해 사용자 정보 탈취와 금전 편취, SNS 계정 정보 탈취 가능성을 경고했다.

특히 국정원은 AI 챗봇을 로맨스 스캠에 악용, 온라인 상 친분 관계를 쌓은 뒤 금전을 편취하는 수법도 공개했다.

딥페이크로 얼굴과 목소리 모방… 영상통화로 돈 뜯는 사례도

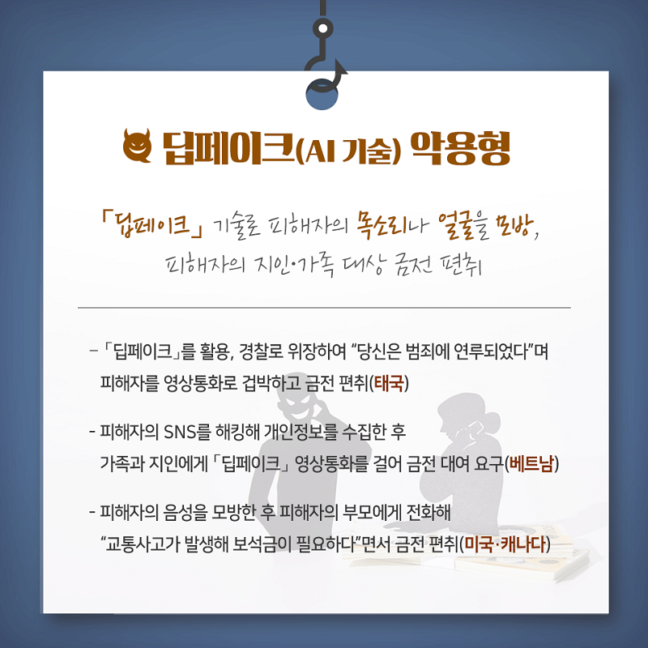

딥페이크 기술로 피해자의 목소리와 얼굴을 모방, 피해자의 지인과 가족을 대상으로 한 범죄도 기승을 부리는 것으로 나타났다.

국정원은 “딥페이크 기술로 경찰을 사칭한 영상 통화로 피해자를 협박한 사례가 태국에서 발생했다”고 밝혔다. 그런가 하면 베트남에서는 피해자의 SNS를 해킹해 개인정보를 수집한 범죄자가 가족과 지인에게 딥페이크 영상 통화로 돈을 빌려 문제가 됐다. 미국과 캐나다에서는 피해자의 음성을 모방해 보석금이 필요하다며 돈을 갈취한 사례도 있었다.

국정원은 이에 대한 대응책과 예방법을 소개했다. 챗GPT 등 AI 기술을 악용한 피싱메일 가능성을 염두에 두고, 출처가 불분명한 이메일이나 파일은 열지 말아야 한다. 또 딥페이크 기술 등이 범죄에 악용될 수 있기 때문에 영상 혹은 음성 통화 시 주의를 기울이되 의심 날 경우 고향이나 출신학교 등 ‘확인질문’을 꼭 해보길 권했다.

이어, SNS에서 개인 정보 공개를 최소화할 것도 당부했다.

뉴스콘텐츠는 저작권법 제7조 규정된 단서조항을 제외한 저작물로서 저작권법의 보호대상입니다. 본 기사를 개인블로그 및 홈페이지, 카페 등에 게재(링크)를 원하시는 분은 반드시 기사의 출처(로고)를 붙여주시기 바랍니다. 영리를 목적으로 하지 않더라도 출처 없이 본 기사를 재편집해 올린 해당 미디어에 대해서는 합법적인 절차(지적재산권법)에 따라 그 책임을 묻게 되며, 이에 따른 불이익은 책임지지 않습니다.

- 에디터김 관식 (seoulpol@wirelink.co.kr)